Escala la guerra de Anthropic contra Trump: demanda al Pentágono por el veto de EEUU

%3Aformat(jpg)%3Aquality(99)%3Awatermark(f.elconfidencial.com%2Ffile%2Fbae%2Feea%2Ffde%2Fbaeeeafde1b3229287b0c008f7602058.png%2C0%2C275%2C1)%2Ff.elconfidencial.com%2Foriginal%2F750%2F43e%2F570%2F75043e5706c5d22bd0e41ce53745752b.jpg&w=1920&q=75)

Key Points

- 1La empresa estadounidense de inteligencia artificial Anthropic acaba de presentar una demanda contra el Departamento de Guerra de Estados Unidos y otras agencias federales después de que el Pentágono la designara oficialmente como “riesgo para la cadena de suministro”, una etiqueta que podría excluir a la compañía de contratos y proyectos militares.

- 2La demanda, presentada este lunes en tribunales federales, busca anular la designación y bloquear su aplicación, argumentando que el Gobierno está utilizando su poder para castigar a la empresa por su postura sobre el uso de la inteligencia artificial.

- 3El conflicto se originó tras semanas de tensiones entre Anthropic y el Pentágono por el uso de su modelo de IA Claude.

- 4La compañía se negó a permitir que su tecnología se empleara para vigilancia masiva o armas autónomas letales, lo que desencadenó un enfrentamiento con el Departamento de Guerra.

- 5Como respuesta, el Pentágono decidió etiquetar a Anthropic como riesgo en la cadena de suministro, una medida normalmente reservada a empresas extranjeras consideradas amenazas para la seguridad nacional.

La empresa estadounidense de inteligencia artificial Anthropic acaba de presentar una demanda contra el Departamento de Guerra de Estados Unidos y otras agencias federales después de que el Pentágono la designara oficialmente como “riesgo para la cadena de suministro”, una etiqueta que podría excluir a la compañía de contratos y proyectos militares. La demanda, presentada este lunes en tribunales federales, busca anular la designación y bloquear su aplicación, argumentando que el Gobierno está utilizando su poder para castigar a la empresa por su postura sobre el uso de la inteligencia artificial. El conflicto se originó tras semanas de tensiones entre Anthropic y el Pentágono por el uso de su modelo de IA Claude. La compañía se negó a permitir que su tecnología se empleara para vigilancia masiva o armas autónomas letales, lo que desencadenó un enfrentamiento con el Departamento de Guerra. Como respuesta, el Pentágono decidió etiquetar a Anthropic como riesgo en la cadena de suministro, una medida normalmente reservada a empresas extranjeras consideradas amenazas para la seguridad nacional. Esta designación impide a contratistas del Gobierno utilizar su tecnología en proyectos vinculados con Defensa. La empresa sostiene que la medida es ilegal y sin precedentes para una compañía estadounidense, y que viola sus derechos constitucionales al penalizar su postura sobre el uso ético de la IA.

El ataque a Irán desata otra guerra: Trump vs. Silicon Valley. Y el desenlace es imprevisible Manuel Ángel Méndez El veto de la administración Trump a Anthropic por negarse a eliminar las salvaguardas en usos militares abre un gigantesco cisma ideológico, financiero y tecnológico que va a tener consecuencias globales

El caso abre un nuevo frente en el debate sobre hasta qué punto las empresas tecnológicas pueden imponer límites al uso militar de sus sistemas de inteligencia artificial. El Pentágono, por su parte, ha defendido que no puede permitir que un proveedor tecnológico limite el uso de capacidades consideradas críticas para las fuerzas armadas. La decisión también podría tener importantes consecuencias económicas para Anthropic, que se arriesga a perder contratos gubernamentales por valor de cientos de millones de dólares y a que otros proveedores que trabajan con el Gobierno busquen alternativas tecnológicas. Mientras tanto, el enfrentamiento se perfila como uno de los primeros grandes litigios entre una empresa líder de IA y el Gobierno estadounidense sobre el control y los límites del uso militar de esta tecnología, en un momento en el que la IA se ha convertido en un elemento clave de la seguridad nacional. OpenAI ha corrido a ocupar el puesto de Anthropic, firmando la semana pasada un acuerdo para ofrecer su tecnología al Pentágono. Sin embargo, no les va a salir gratis.

Sam Altman, CEO de OpenAI. (Reuters) La responsable de hardware y robótica de OpenAI, Caitlin Kalinowski, dimitió durante el fin de semana tras el polémico acuerdo que la empresa firmó con el Departamento de Guerra. La ejecutiva había llegado a la compañía en 2024 procedente de Meta para liderar el desarrollo de hardware y robots en la empresa. En un mensaje público, Kalinowski explicó que su salida responde a motivos éticos. Reconoció que la inteligencia artificial puede desempeñar un papel importante en la seguridad nacional, pero afirmó que cuestiones como la vigilancia de ciudadanos sin supervisión judicial o el uso de sistemas autónomos letales requieren un debate mucho más profundo. "La IA tiene un papel importante en la seguridad nacional. Pero la vigilancia de estadounidenses sin supervisión judicial y la autonomía letal sin autorización humana son líneas que merecían más deliberación de la que tuvieron", aseguró. "Esto ha sido una cuestión de principios, no de personas".

Free Daily Briefing

Top AI intelligence stories delivered each morning.

Related Articles

AI Disruption Causes Job Loss in Company

US Public Dissent vs China’s Embrace of AI Progress

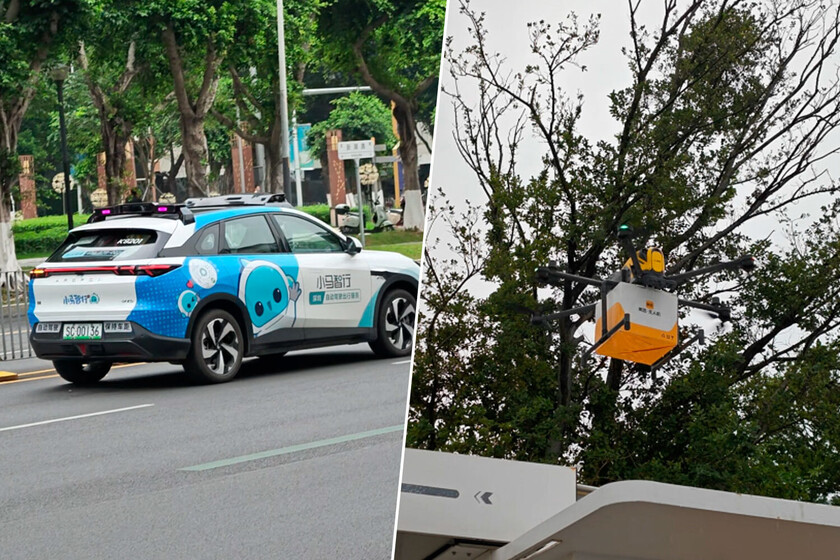

Shenzhen Launches Drone Delivery and Autonomous Taxis

Musk Admits xAI Trained Grok Using ChatGPT